아카마이(AKAM)가 AI 추론 기술을 글로벌 네트워크로 확장하며 기존 클라우드 인프라가 가진 한계를 극복하려는 움직임을 본격화했다.

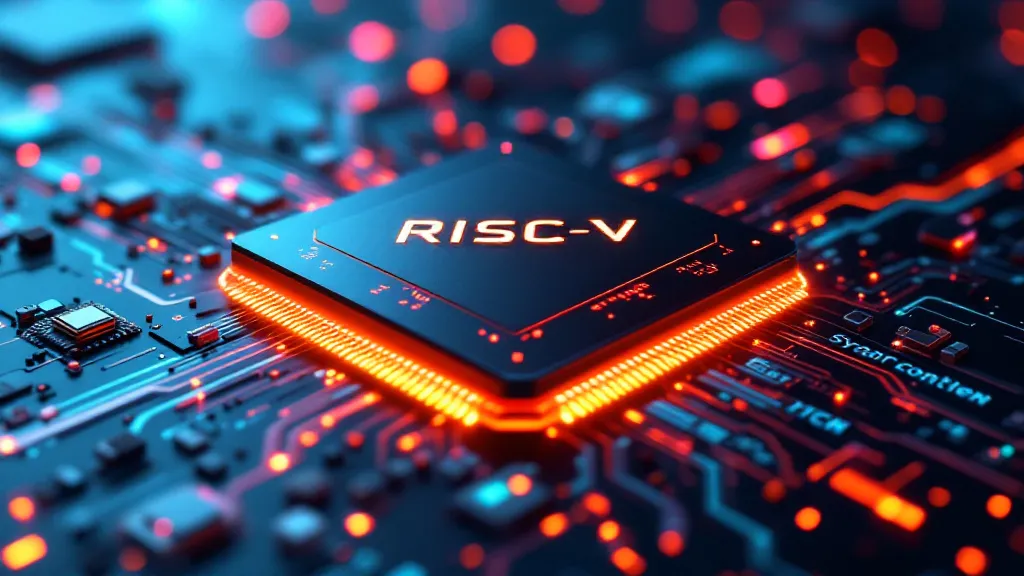

아카마이는 최근 '아카마이 클라우드 인퍼런스(Akamai Cloud Inference)' 서비스를 출시하며, 대규모 언어 모델(LLM) 실행을 보다 사용자와 가까운 곳에서 수행할 수 있는 분산형 인프라를 선보였다. 이는 전통적인 중앙집중형 클라우드 환경에서 발생하는 높은 지연 시간 문제를 해결하는 데 초점을 맞춘 것이다.

아담 카론(Adam Karon) 아카마이 최고운영책임자(COO)는 "기존 클라우드 환경에서는 AI 모델 학습이 대규모 데이터센터에서 이뤄지지만, 실질적인 추론 작업은 엣지에서 수행하는 것이 더 효율적"이라며 "아카마이가 구축한 글로벌 콘텐츠 전송 네트워크(CDN)는 AI 추론에 최적화된 인프라를 제공할 것"이라고 강조했다.

아카마이는 4,100개 이상의 네트워크 거점과 130개국 이상에 걸친 광범위한 분산형 인프라를 바탕으로 기존 클라우드 서비스 대비 AI 추론 속도를 최대 2.5배 이상 높이고, 처리량을 세 배로 증가시킬 수 있다고 주장하고 있다. 또한 엔비디아(NVDA)의 AI 엔터프라이즈 소프트웨어와 통합해 개발자들에게 보다 최적화된 컴퓨팅 환경을 지원할 예정이다.

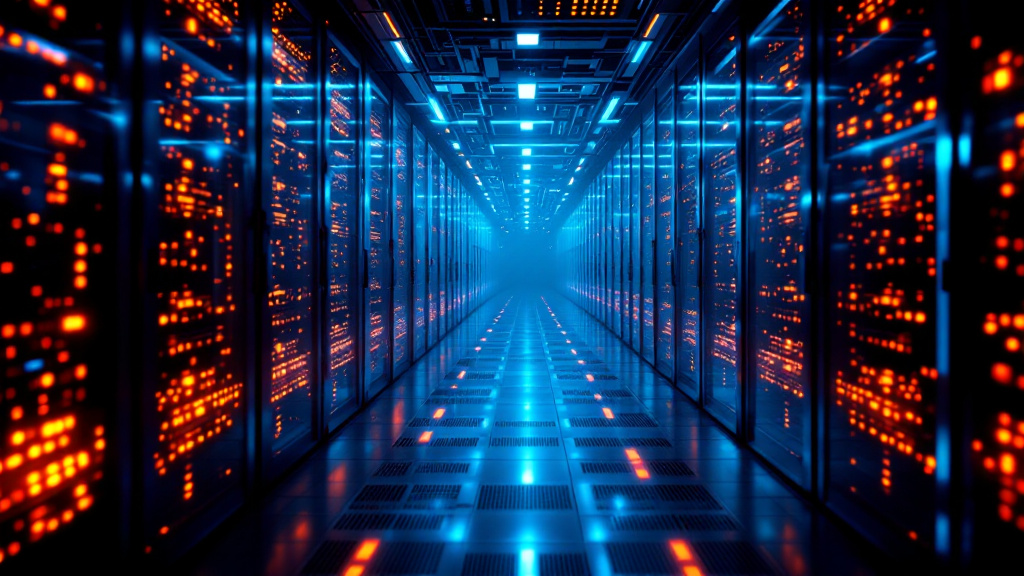

업계 전문가들은 아카마이의 이러한 전략이 AI 모델이 점차 규모가 커지고 실시간 반응 속도가 중요한 산업에서 큰 영향을 미칠 것으로 보고 있다. 가트너(Gartner)는 올해 말까지 전 세계 데이터의 75%가 중앙 데이터센터가 아닌 엣지에서 생성될 것이라고 전망했다. 이에 따라 AI 응용 분야에서도 실시간 데이터 분석과 처리가 중요한 요소로 떠오를 전망이다.

아카마이는 데이터 생성 지점과 가까운 곳에서 AI 추론을 수행함으로써 자율주행차, 스마트 농업, 실시간 쇼핑 분석 등 다양한 산업에서 강점을 발휘할 수 있을 것으로 보인다. AI 기반 응용 프로그램이 상시적으로 신속한 의사 결정을 요구하는 흐름 속에서, 아카마이의 새로운 서비스가 기존 클라우드 인프라의 대안으로 자리 잡을지 주목된다.

0

0