기술의 효용성과 영향력이 증가하는 만큼, 인공지능으로 인한 부작용과 역기능을 방지하기 위한 대응과 통제 수단 마련이 필요하다는 의견이 나왔다.

국회입법조사처는 지난 4일 '인공지능의 공정성・책임성・투명성・윤리의식(FATE)를 위한 입법 논의 동향과 시사점'을 다룬 '이슈와 논점' 보고서를 통해 이같이 밝혔다.

인공지능, 알고리즘, 자동화 사고 및 논쟁 공공 데이터베이스’에 보고된 인공지능 사고 및 논쟁 수는 2012년 10건에서 2021년 260건으로 26배 증가했다.

인공지능 위험에 대한 우려가 급속하게 증가함에 따라 공정성(Fairness), 책임성(Accountability), 투명성(Transparency), 윤리의식(Ethics), 일명 ‘FATE’에 대한 규제가 어느 정도 필요하다는 점에 대해서는 사회적 합의가 도출되고 있는 것으로 보인다.

개인정보, 온라인 플랫폼 관련 법률은 일부 규제를 개별적으로 담고 있다.

유럽연합(EU)은 인공지능법안에 대한 최종단계로, 2023년 6월 기준으로 EU 의회, EU 집행위원회 및 이사회가 3자 협상을 진행 중이다.

안전, 생계, 권리에 명백한 위협으로 간주되는 인공지능 시스템은 금지하고, 고위험에 해당하는 인공지능 시스템에는 위험관리 시스템 운영, 위험과 차별 결과를 최소화하는 데이터 마련, 결과의 추적성을 보장하기 위한 자동 로그 생성, 위험에 대한 정보 제공, 기본권 영향평가 등의 의무를 부여한다.

인공지능에 대해서는 사람이 인공지능과 상호작용하고 있음을 알리고, 기본권, 민주주의, 안전 등에 위반되지 않는 콘텐츠를 생성할 것을 요구한다.

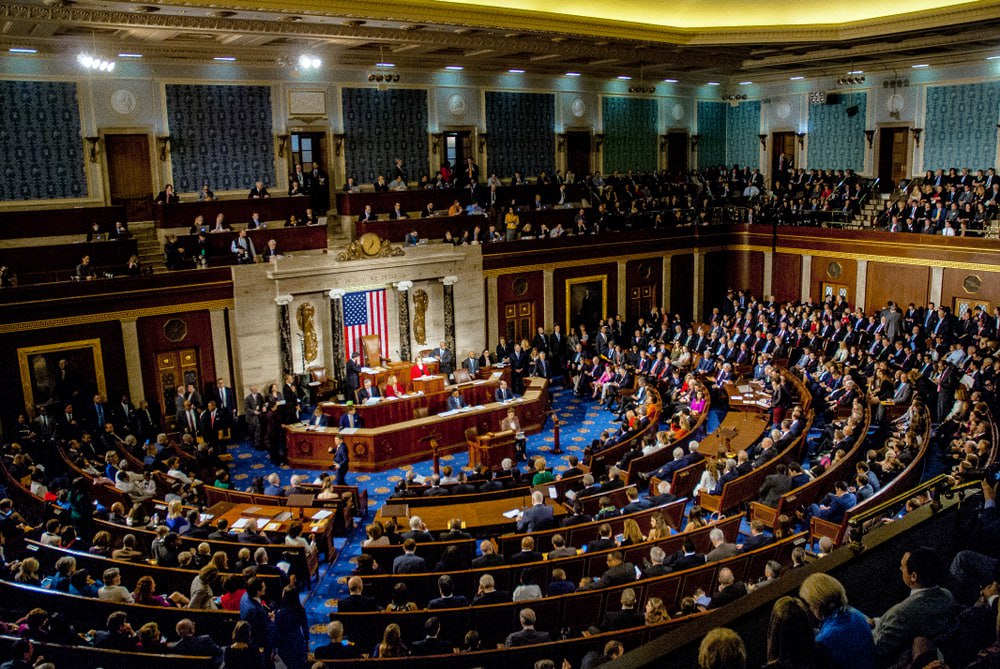

2019년에 이어 2022년에도 미국 상・하원에 각각 '알고리즘책임법안(Algorithm Accountability Act of 2021)'이 발의됐다.

알고리즘을 개발, 배포하는 일정 기준 이상의 기업으로 하여금 자동화된 의사결정 시스템과 그 시스템을 중요한 의사결정에 활용하는 과정이 소비자에게 미치는 영향을 평가하도록 하여 투명성과 책임성을 부과하고 있다.

최근 7건의 법률안을 병합한 '인공지능산업 육성 및 신뢰 기반 조성에 관한 법률안' 이 과학기술정보방송통신위원회 법안심사소위원회를 통과했다.

공정성・책임성・투명성・윤리의식(FATE)를 위해서 데이터 출처・품질을 점검하고 인공지능 시스템의 기능과 보안을 평가하는 내부 거버넌스를 구축하고, 위험을 평가해 경감 조치를 취하도록 하되, 단계적으로 통제 수단을 도입할 필요가 있다.

또한, 규제의 실효성을 확보하기 위해서 정부의 인공지능 검증, 조사 및 집행 역량을 확보해야 한다.

4

4