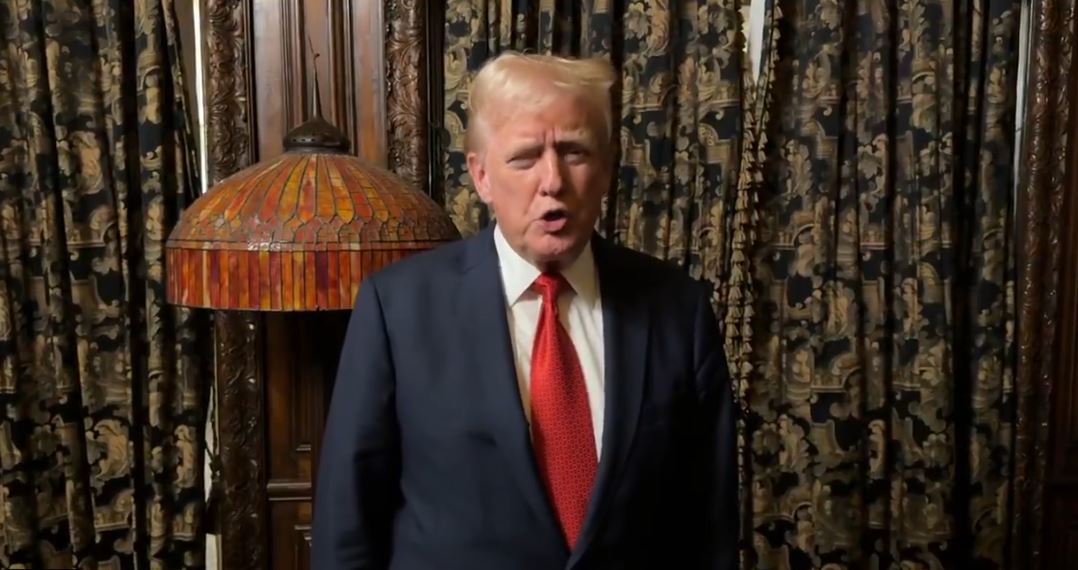

마크 저커버그(Mark Zuckerberg)는 AI를 활용해 콘텐츠 크리에이터가 팬들과의 소통을 개선할 수 있다고 전망했다. AI 봇이 크리에이터의 성격과 비즈니스 목표를 반영해 팬들과 상호작용하도록 하여, 크리에이터는 더 중요한 작업에 집중할 수 있을 것으로 기대된다.

24일(현지시간) 테크크런치에 따르면, 콘텐츠 크리에이터들은 주당 20시간 이상을 새로운 콘텐츠 제작에 할애하고 있어, 팬들과의 소통 시간이 부족한 경우가 많다. 그러나 메타(Meta)의 CEO 마크 저커버그는 AI가 이 문제를 해결할 수 있다고 생각하고 있다.

인터넷 유명인사 로완 청(Rowman Cheung)과의 인터뷰에서 저커버그는 크리에이터들이 자신의 성격과 '비즈니스 목표'를 반영하는 AI 봇을 보유하는 미래를 제시했다. 저커버그는 이러한 봇이 커뮤니티 소통을 일부 담당함으로써 크리에이터들이 더 중요한 작업에 집중할 수 있을 것이라고 말했다.

저커버그는 "모든 크리에이터가 소셜 미디어의 모든 정보를 끌어와 이러한 시스템을 훈련시켜 자신의 가치와 목표, 그리고 하고자 하는 일을 반영하게 할 수 있는 거대한 전환점이 있을 것"이라며 "사람들이 다양한 방식으로 상호작용할 수 있는 예술적 유물이 될 것"이라고 설명했다.

이러한 저커버그의 생각은 많은 테크노 낙관주의자들 사이에서 흔한 견해로, AI가 단일 개인 또는 조직이 미치는 영향을 크게 확대할 수 있다는 약속 때문에 본질적으로 좋은 것이라는 것이다. (구글(Google) 역시 크리에이터를 위한 AI 도구를 제안한 바 있다.) 그러나 생산성이 개인적인 터치를 희생할 때, 팬들이 진정성을 중요시하는 크리에이터들이 과연 생성형 AI를 받아들일지 의문이다.

메타의 AI 봇이 도입 초기부터 많은 문제를 일으켰다는 점도 저커버그의 주장에 도움이 되지 않는다. 메타가 올해 초 메타 AI 추진의 일환으로 AI 봇을 출시하기 시작했을 때, 이 봇들은 오늘날 생성형 AI 기술의 많은 함정, 특히 환각에 빠지기 쉽다는 점을 드러냈다. 예를 들어, AP 통신은 한 봇이 맨해튼 엄마들을 위한 페이스북 그룹 대화에 끼어들어 NYC 학교 구역에 자녀가 있다고 주장하는 사례를 관찰했다. 또 다른 봇은 보스턴 근처의 무료 물품 교환 포럼에서 존재하지 않는 카메라와 에어컨을 나눠주겠다고 제안했다.

공정하게 말하자면, 메타의 AI는 개선되고 있다고 회사는 주장하고 있다. 최신 릴리스인 라마 3.1(Llama 3.1) 모델 가족은 메타의 플랫폼 전반에 걸쳐 여러 기능을 지원할 예정이며, 벤치마크에 따르면 메타의 가장 정교한 모델이다. 하지만 생성형 AI에서 환각 및 계획과 추론의 일반적인 실수는 여전히 해결되지 않은 문제로 남아 있으며, 메타는 이 문제에 대한 연구적 돌파구를 제시하지 못하고 있다.

크리에이터들이 결함 있는 AI 봇에 팬들과의 상호작용을 맡기는 것을 상상하기는 어렵다. 저커버그는 인터뷰에서 메타가 생성형 AI 사용과 관련된 우려를 '완화'하고 장기적으로 사용자 신뢰를 얻어야 한다는 점을 인정했다. 이는 메타의 AI 훈련 관행이 일부 크리에이터들을 플랫폼에서 멀어지게 하고 있는 상황에서 특히 중요하다.

뉴스 속보를 실시간으로...토큰포스트 텔레그램 가기

1

1